| 名称 | Robots爬虫协议生成器 |

| 版本号 | V1.01 |

| 应用编号 | APP1619 |

| 应用类型 | 插件 |

| 发布时间 | 2024-07-10 18:01:39 |

| 更新时间 | 2025-07-05 10:55:16 |

| 插件类型 | 工具类 |

| 功能类别 | SEO |

| 依赖场景 | 不依赖于任何插件 |

| 源码加密 | 未加密 |

| 技术保障 | 商业版源码由迅睿官方提供售后服务 |

| 支持浏览器 | Chromium内核浏览器、Chrome、Edge、Firefox、Safari、Opera等 |

源码说明

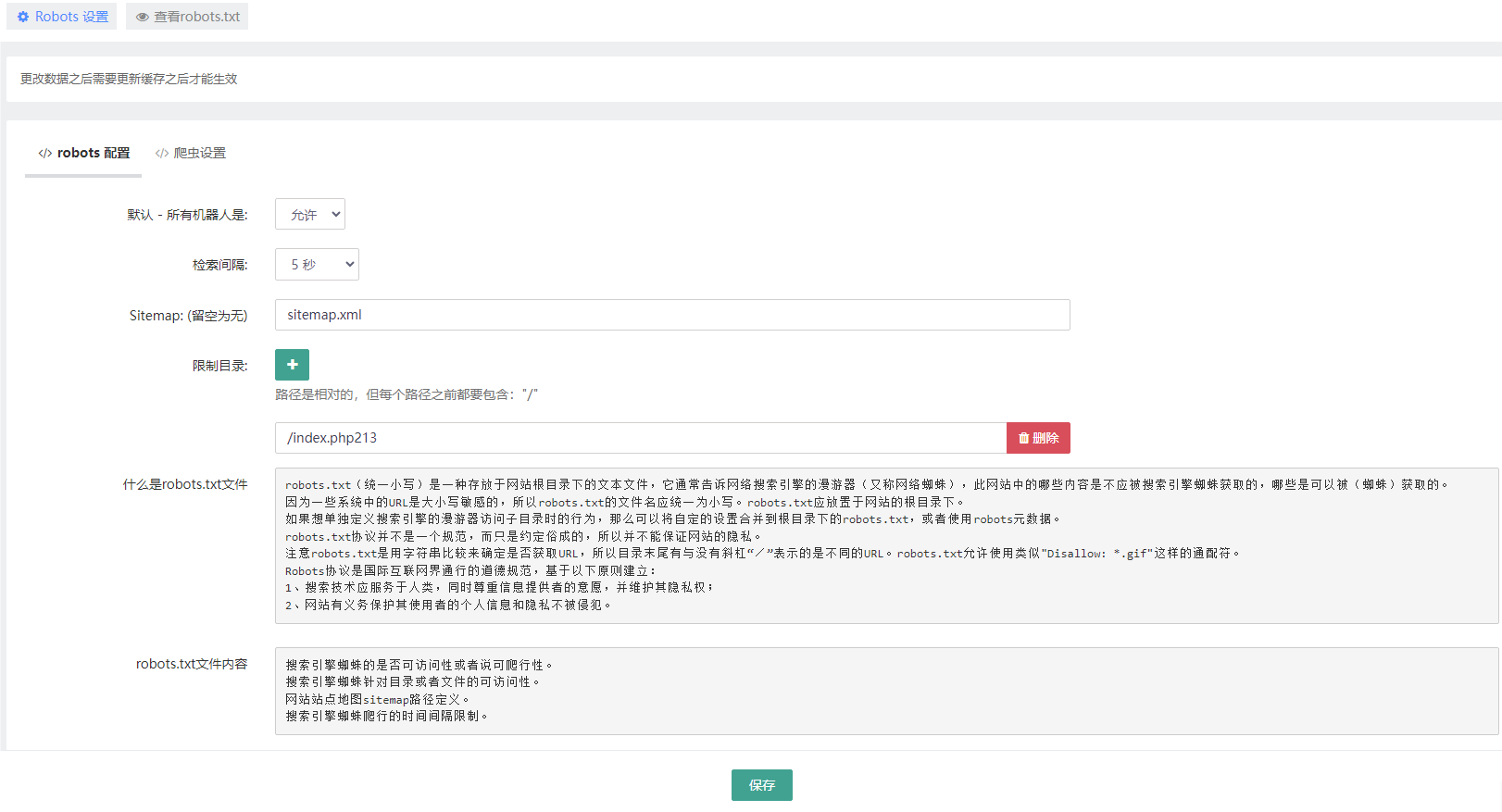

robots.txt(统一小写)是一种存放于网站根目录下的文本文件,它通常告诉网络搜索引擎的漫游器(又称网络蜘蛛),此网站中的哪些内容是不应被搜索引擎蜘蛛获取的,哪些是可以被(蜘蛛)获取的。

因为一些系统中的URL是大小写敏感的,所以robots.txt的文件名应统一为小写。

robots.txt应放置于网站的根目录下。

如果想单独定义搜索引擎的漫游器访问子目录时的行为,那么可以将自定的设置合并到根目录下的robots.txt,或者使用robots元数据。

robots.txt协议并不是一个规范,而只是约定俗成的,所以并不能保证网站的隐私。

注意robots.txt是用字符串比较来确定是否获取URL,所以目录末尾有与没有斜杠“/”表示的是不同的URL。robots.txt允许使用类似"Disallow: *.gif"这样的通配符。

Robots协议是国际互联网界通行的道德规范,基于以下原则建立:

1、搜索技术应服务于人类,同时尊重信息提供者的意愿,并维护其隐私权;

2、网站有义务保护其使用者的个人信息和隐私不被侵犯。